Saiba como sua empresa pode criar aplicativos para automatizar tarefas e gerar mais eficiência por meio de ferramentas low-code/no-code em 9 de novembro na conferência virtual Low-Code/No-Code. Registre-se aqui.

‘Tis a temporada de inteligência artificial generativa (AI). Na semana passada, a Meta anunciou o Make-A-Video, um sistema de IA que permite aos usuários transformar prompts de texto em videoclipes curtos, de alta qualidade e únicos. Agora, o Google não está muito atrás. A tendência de texto para vídeo mostra todos os sinais de se preparar para explodir, assim como o texto para imagem fez no ano passado com DALL-E, MidJourney e Stable Diffusion.

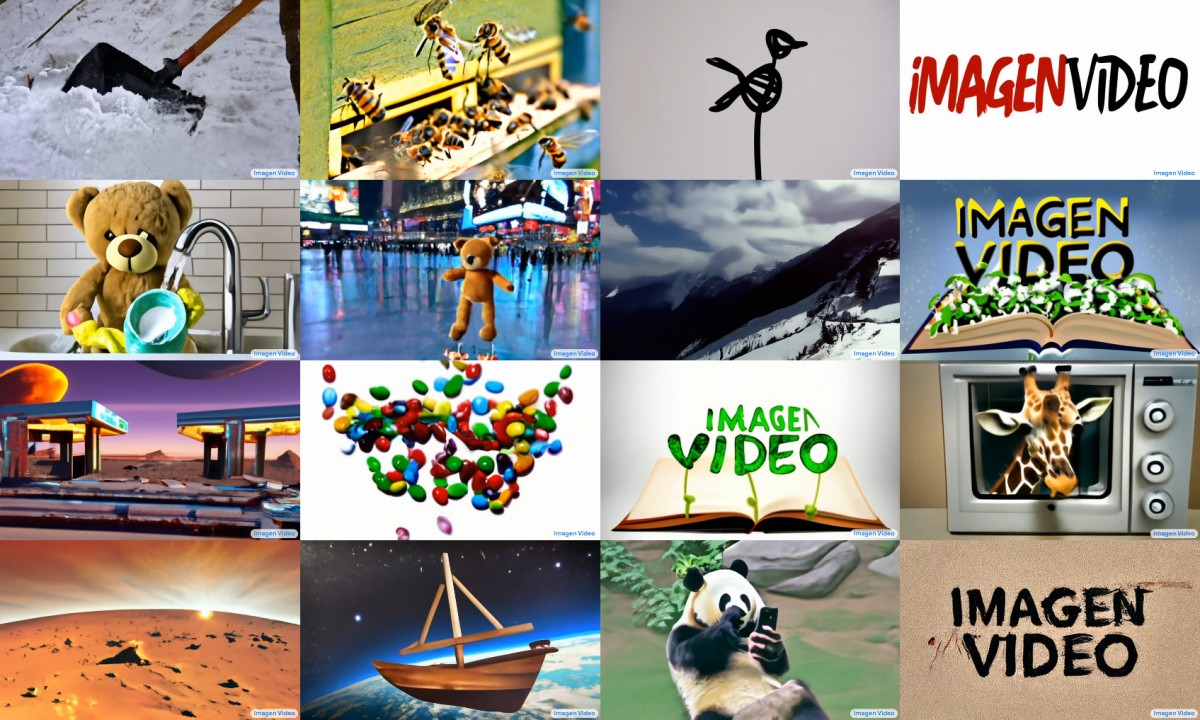

Anunciado ontem, o Imagen Video do Google é um modelo de IA generativo de texto para vídeo capaz de produzir vídeos de alta definição a partir de um prompt de texto. O modelo de difusão de vídeo condicionado por texto pode gerar vídeos com resolução de até 1280×768 a 24 quadros por segundo.

O Imagen Video do Google oferece alta fidelidade

Em seu artigo recentemente publicado “Imagen Video: geração de vídeo de alta definição com modelos de difusão”, o Google afirma que o Imagen Video é capaz de gerar vídeos com alta fidelidade e possui alto grau de controlabilidade e conhecimento do mundo. As capacidades do modelo generativo incluem a criação de diversos vídeos e animações de texto em diferentes estilos artísticos, compreensão 3D, renderização de texto e animação. O modelo está atualmente em fase de pesquisa, mas sua chegada ocorre apenas cinco meses depois que a Imagen mostrou o rápido desenvolvimento de modelos baseados em síntese.

O Imagen Video consiste em um codificador de texto (congelado T5-XXL), um modelo de difusão de vídeo básico e modelos de difusão de super-resolução espacial e temporal intercalados. Para criar essa arquitetura, o Google afirma ter transferido as descobertas do trabalho anterior sobre geração de imagens baseada em difusão para a configuração de geração de vídeo. A equipe de pesquisa também inculcou a destilação progressiva nos modelos de vídeo com orientação sem classificador para amostragem rápida e de alta qualidade.

Evento

Cúpula Low-Code/No-Code

Junte-se aos principais executivos de hoje no Low-Code/No-Code Summit virtualmente em 9 de novembro. Registre-se para seu passe gratuito hoje.

Registre-se aqui

Cascata de sete modelos de difusão de sub-vídeo

A estrutura de geração de vídeo é uma cascata de sete modelos de difusão de sub-vídeo que realizam geração de vídeo condicional de texto, super-resolução espacial e super-resolução temporal. Com toda a cascata, o Imagen Video gera vídeos de alta definição 1280×768 a 24 quadros por segundo para 128 quadros — aproximadamente 126 milhões de pixels. Com a ajuda da destilação progressiva, o Imagen Video pode gerar vídeos de alta qualidade usando apenas oito etapas de difusão por submodelo. Isso acelera o tempo de geração de vídeo por um fator de cerca de 18 vezes.

As várias habilidades estilísticas notáveis do modelo também incluem a geração de vídeos baseados no trabalho de pintores renomados como Vincent van Gogh, renderizando objetos giratórios em 3D, preservando sua estrutura e renderizando texto em vários estilos de animação.

O Google diz que o Imagen Video foi treinado no conjunto de dados de imagem-texto LAION-400M disponível publicamente, bem como 14 milhões de pares de vídeo-texto e 60 milhões de pares de imagem-texto. Os conjuntos de dados de treinamento permitiram generalizar uma variedade de estéticas. Além disso, um benefício dos modelos em cascata descobertos pela equipe de desenvolvimento do Google foi que cada modelo de difusão pode ser treinado independentemente, permitindo treinar todos os sete modelos em paralelo.

Um dilema de dados do Google

Como os modelos generativos também podem ser usados indevidamente para gerar conteúdo falso, odioso, explícito ou prejudicial, o Google afirma que tomou várias medidas para minimizar essas preocupações. Por meio de testes internos, a empresa afirmou que foi capaz de aplicar filtragem de prompt de texto de entrada e filtragem de conteúdo de vídeo de saída, mas alertou que ainda existem vários desafios importantes de segurança e ética que devem ser trabalhados.

O Imagen Video e seu codificador de texto T5-XXL congelado foram treinados em “dados problemáticos”. Embora os testes internos mostrem que muito do conteúdo explícito e violento pode ser filtrado, o Google diz que ainda existem preconceitos e estereótipos sociais que podem ser difíceis de detectar e filtrar. Esse foi um dos principais motivos pelos quais o Google decidiu não liberar o modelo ou seu código-fonte publicamente até que as preocupações fossem mitigadas.

IA generativa no Google e além?

De acordo com Dumitru Erhan, cientista de pesquisa da equipe do Google Brain, há esforços para fortalecer a pesquisa por trás do Phenaki – outro sistema de texto para vídeo do Google – que pode transformar instruções de texto detalhadas em vídeos de mais de dois minutos; cuja principal desvantagem é a qualidade de vídeo mais baixa.

A equipe que trabalha em Phenaki diz que o modelo pode aproveitar os vastos conjuntos de dados de imagens de texto para gerar vídeos, onde o usuário também pode narrar e alterar cenas dinamicamente.

Uma tendência generativa de IA que começou com texto para imagem e começou a se mover para texto para vídeo, também parece estar se transformando lentamente em texto para 3D – com modelos como o CLIP-Forge, um modelo de geração de formas que pode gerar objetos 3D usando aprendizado zero-shot.

A própria IA de texto para 3D do Google “DreamFusion”, lançada na semana passada, é outro excelente exemplo de IA generativa se movendo em direção a uma abordagem de síntese 3D mais agressiva. DreamFusion utiliza Imagen para otimizar uma cena 3D.

A missão do VentureBeat é ser uma praça digital para os tomadores de decisões técnicas adquirirem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.

Fonte: venturebeat.com